DSP's gebruiken voor audio-AI aan de rand

Eens beperkt tot cloudservers met praktisch oneindige bronnen, wordt machine learning om verschillende redenen steeds belangrijker in edge-apparaten, waaronder lagere latentie, lagere kosten, energie-efficiëntie en verbeterde privacy. De tijd die nodig is om gegevens voor interpretatie naar de cloud te sturen, kan onbetaalbaar zijn, zoals voetgangersherkenning in een zelfrijdende auto. De bandbreedte die nodig is om gegevens naar de cloud te sturen, kan kostbaar zijn, om nog maar te zwijgen van de kosten van de cloudservice zelf, zoals spraakherkenning voor spraakopdrachten.

Energie is een afweging tussen het heen en weer verzenden van gegevens naar de server versus gelokaliseerde verwerking. Machine learning-berekeningen zijn complex en kunnen de batterij van een edge-apparaat gemakkelijk leegmaken als ze niet efficiënt worden uitgevoerd. Edge-beslissingen houden de gegevens ook op het apparaat, wat belangrijk is voor de privacy van gebruikers, zoals gevoelige e-mails die worden gedicteerd door spraak op een smartphone. Audio AI is een rijk voorbeeld van inferentie aan de rand; en een nieuw type digitale signaalprocessor (DSP), gespecialiseerd voor gebruiksscenario's voor machine learning van audio, kan betere prestaties en nieuwe functies aan de rand van het netwerk mogelijk maken.

Always-on voice wake is een van de vroegste voorbeelden van machine learning aan de rand:luisteren naar een trefwoord zoals "Hey Siri" of "OK Google" voordat de rest van het systeem wordt gewekt om de volgende actie te bepalen. Als deze trefwoorddetectie op een generieke applicatieprocessor zou worden uitgevoerd, zou dit ruim 100 mW kunnen kosten. In de loop van een dag zou dit de batterij van de smartphone leegmaken. Daarom hadden de eerste telefoons die deze functie implementeerden algoritmen die waren geport naar een kleine DSP die op minder dan 5mW kon draaien. Tegenwoordig kunnen dezelfde algoritmen worden uitgevoerd op een gespecialiseerde DSP voor audio en machine learning in een slimme microfoon van minder dan 0,5 mW.

Zodra een edge-apparaat is ingeschakeld voor always-on audio machine learning, kan het meer dingen doen dan spraakherkenning op laag vermogen:contextueel bewustzijn, zoals of het apparaat zich in een druk restaurant of drukke straat bevindt, herkenning van omgevingsmuziek, ultrasone kamerherkenning, en zelfs herkennen of iemand in de buurt schreeuwt of lacht. Dit soort functies maakt nieuwe geavanceerde gebruiksscenario's mogelijk die het edge-apparaat kunnen verbeteren en de gebruiker ten goede kunnen komen.

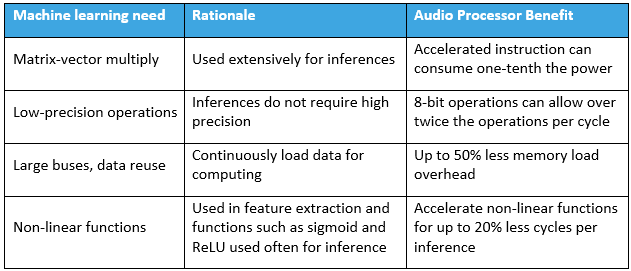

De beste prestaties en energie-efficiëntie voor machine learning-inferentie aan de rand vereist uitgebreide hardware-aanpassing. Enkele van de meest impactvolle technieken zijn verzameld in Tabel 1. Het implementeren van deze functies zal de efficiëntie van de inferentie van machine learning aan de rand verbeteren.

De meeste rekenkundige bewerkingen die nodig zijn voor neurale netwerkinferentie zijn matrix-vectorvermenigvuldigingen. Dit komt omdat modellen voor machine learning doorgaans worden weergegeven als matrices, die worden toegepast op nieuwe stimulerende middelen die als vectoren worden weergegeven. De meest gebruikelijke techniek om de inferentie van machine learning aan de rand te verbeteren, is om matrix-vectorvermenigvuldiging zeer efficiënt te maken. Een gefuseerde vermenigvuldiging gevolgd door een accumulatie (MAC) is een gebruikelijke manier om dit aan te pakken.

Hoewel de trainingsfase gevoelig is voor numerieke precisie, kan de inferentiefase bijna equivalente resultaten bereiken met lage precisie (bijvoorbeeld 8-bits). Het beperken van de precisie kan de complexiteit van de edge-berekening aanzienlijk verminderen. Om deze reden hebben processorbedrijven zoals Intel en Texas Instruments MAC's met beperkte precisie toegevoegd. De TMS320C6745 van Texas Instruments kan 8 MAC's van elk 8 bits per cyclus uitvoeren. Ook ondersteunt de audio-DSP van Knowles 16 MACS van elk 8-bits per cyclus.

Zowel de trainings- als de inferentiefase zetten het geheugensubsysteem onder druk. Processorondersteuning voor grote woordbreedtes is vaak verbeterd om hieraan tegemoet te komen. Intel's recentere krachtige processors hebben AVX-512 die de overdracht van 512-bits per cyclus naar een array van 64 multipliers ondersteunt. De Texas Instruments 6745 gebruikt een 64-bits bus om de geheugenbandbreedte te vergroten. De geavanceerde audioprocessors van Knowles gebruiken een 128-bits bus die een goede balans biedt tussen een groot chipgebied en een hoge bandbreedte. Bovendien vereisen audio-machine learning-architecturen (zoals RNN of LSTM) vaak feedback. Dit stelt extra eisen aan de chiparchitectuur, aangezien data-afhankelijkheid sterk gepijplijnde architecturen kan blokkeren.

Hoewel traditionele machine learning kan werken met onbewerkte gegevens, voeren algoritmen voor audio-machine learning doorgaans spectrale analyses en functie-extractie uit om neurale netwerken te voeden. Versnelling van traditionele signaalverwerkingsfuncties zoals FFT's, audiofilters, trigonometrische functies en logaritmen zijn noodzakelijk voor energie-efficiëntie. Daaropvolgende bewerkingen maken vaak gebruik van een verscheidenheid aan niet-lineaire vectorbewerkingen, zoals een sigmoid, geïmplementeerd als een hyperbolische tangens of gerectificeerde lineaire eenheid (absolute waardefunctie waarbij alle negatieve getallen in nul worden veranderd). Deze geavanceerde niet-lineaire bewerkingen nemen veel cycli in beslag op traditionele processors. Single-cycle instructies voor deze functies verbeteren ook de energie-efficiëntie van machine learning Audio DSP's.

Samenvattend:geavanceerde processors die gespecialiseerd zijn in zowel machine learning als audioverwerking, maken realtime always-on edge-inferentie mogelijk tegen lage kosten, terwijl tegelijkertijd de privacy behouden blijft. Het energieverbruik wordt laag gehouden door architecturale beslissingen over de ondersteuning van instructieset om meerdere bewerkingen per cyclus mogelijk te maken en bredere geheugenbussen om hoge prestaties te behouden bij een laag stroomverbruik. Terwijl bedrijven blijven innoveren op gespecialiseerde computing aan de edge, zullen de use-cases voor machine learning die er gebruik van maken alleen maar toenemen.

Jim Steele is vice-president technologiestrategie bij Knowles Corp.

>> Dit artikel is oorspronkelijk gepubliceerd op onze zustersite, EE Times:"Machine Learning op DSP's:audio-AI aan de rand inschakelen."

Internet of Things-technologie

- De toeleveringsketen en machine learning

- Het is tijd voor verandering:een nieuw tijdperk aan de rand

- NXP verdubbelt machine learning at the Edge

- Trends blijven de verwerking tot het uiterste pushen voor AI

- Kunstmatige intelligentie versus machinaal leren versus diep leren | Het verschil

- Tips voor het kiezen van de juiste CNC-machine

- Richtlijnen voor het gebruik van DSP-handvat:

- Machine learning in het veld

- Intel roept Udacity in om graad voor AI on the Edge toe te kennen

- De noodzaak van open source aan de rand (eBook)

- On the Edge of Glory:een nieuw tijdperk van internetmachines mogelijk maken