Trainingsbias in machine learning aanpakken

Iedereen iets leren over 'eerlijkheid' is een prijzenswaardig doel.

Als mensen zijn we het misschien niet per se eens over wat eerlijk is. Het hangt soms af van de context. Kinderen leren eerlijk te zijn - zowel thuis als op school - is van fundamenteel belang, maar het is gemakkelijker gezegd dan gedaan. Hoe kunnen we, met dit in gedachten, als samenleving de nuances van 'eerlijk zijn' communiceren naar kunstmatige intelligentie (AI)-systemen?

Een team van onderzoekers van IBM Research pakt dit raadsel voor het eerst op. IBM introduceert een toolkit voor ontwikkelaars genaamd 'AI Fairness 360'. Als onderdeel van deze inspanning biedt IBM bedrijven een nieuwe "cloud-based, bias-detectie en mitigation-service" die bedrijven kunnen gebruiken om te testen en te verifiëren hoe AI-gestuurde systemen zich gedragen.

In een telefonisch interview met EE Times vertelde Saska Mojsilovic, een Fellow bij IBM Research, ons dat wetenschappers en AI-beoefenaars veel te veel gefocust zijn op de nauwkeurigheid van AI. Meestal is de eerste vraag die mensen stellen over AI:"Kunnen machines mensen verslaan?"

Maar hoe zit het met eerlijkheid? De leegte van rechtvaardigheid in AI kan catastrofale gevolgen hebben in bijvoorbeeld de gezondheidszorg of autonome voertuigen, zei ze.

Wat als een dataset die wordt gebruikt om een machine te trainen, bevooroordeeld is? Als AI niet kan uitleggen hoe het tot een beslissing is gekomen, hoe kunnen we dan de "juistheid" ervan verifiëren? Kan AI onthullen of gegevens op de een of andere manier zijn gemanipuleerd tijdens AI-verwerking? Kan AI ons verzekeren dat zijn gegevens nooit zijn aangevallen of gecompromitteerd, ook niet tijdens de voor- en nabewerking?

Kortom, bestaat er zoiets als introspectieve AI? Het simpele antwoord:Nee.

Zonder transparant te zijn voor AI-gebruikers, ontwikkelaars en beoefenaars, kunnen AI-systemen het vertrouwen van de samenleving niet winnen, zei Mojsilovic.

Eerlijkheid ontbinden

Een grotere vraag is hoe de machine te leren wat eerlijkheid is. Mojsilovic merkte op:"Omdat we wetenschappers zijn, was het eerste wat we deden om 'eerlijkheid' te ontbinden. We moesten er omheen zien te komen." Ze hebben eerlijkheid afgebroken in termen van statistieken, algoritmen en vooroordelen die worden toegepast bij AI-implementatie.

Kush Varshney, onderzoekswetenschapper, IBM, legde uit dat het team keek naar vooringenomenheid en eerlijkheid in AI-algoritmen en AI-besluitvorming. “Er is rechtvaardigheid tegenover individuen en er is rechtvaardigheid tegenover groepen. We hebben gekeken naar verschillende kenmerken van groepen - variërend van geslacht tot ras. Ook juridische en regelgevende kwesties komen aan de orde.” Uiteindelijk heeft het team 30 verschillende statistieken gemeten om te zoeken naar vertekening in datasets, AI-modellen en algoritmen.

Deze bevindingen zijn verwerkt in de AI Fairness 360-toolbox die IBM deze week lanceerde. Het bedrijf beschreef het als "een uitgebreide open-source toolkit met statistieken om te controleren op ongewenste vooroordelen in datasets en machine-learningmodellen."

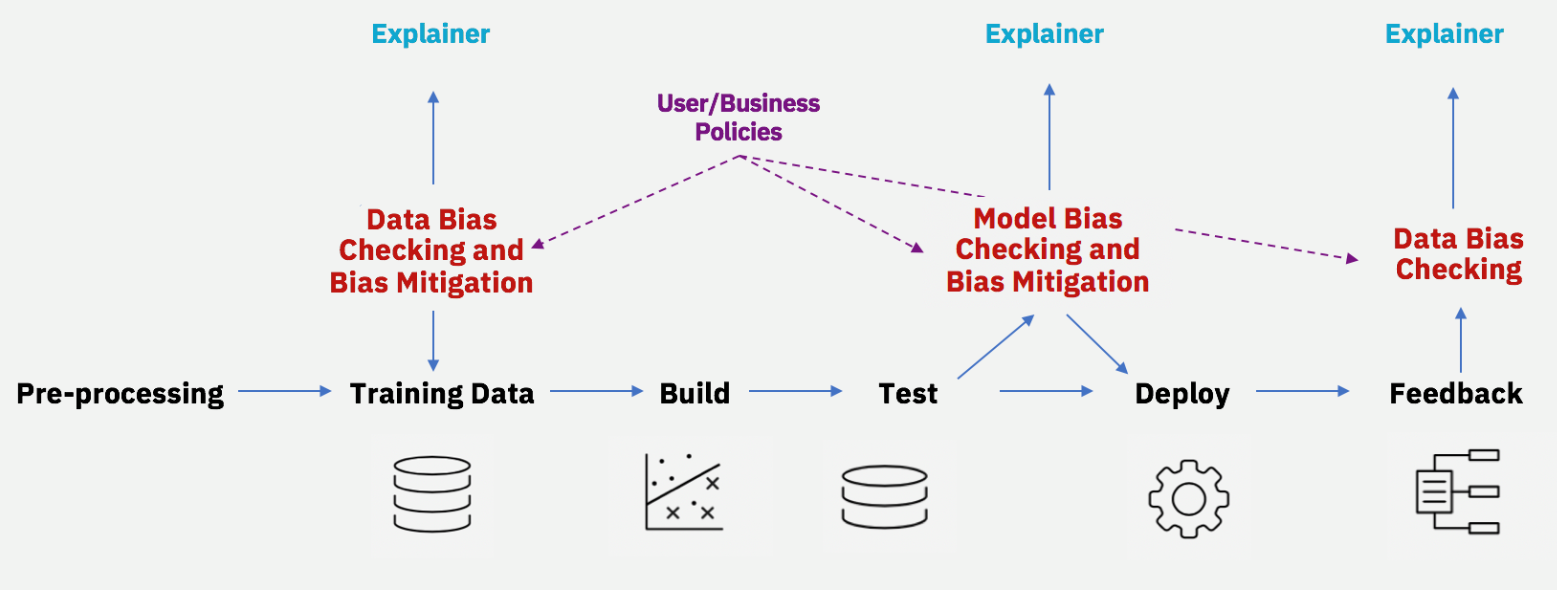

Vooroordelen verminderen gedurende de hele AI-levenscyclus (Bron:IBM)

Hoewel veel wetenschappers al werken aan het opsporen van discriminatie in AI-algoritmen, zei Mojsilovic dat de aanpak van IBM verschilt door algoritmen op te nemen, niet alleen om vooroordelen te vinden, maar ook een hulpmiddel om vooringenomenheid te verminderen.

Op een basisniveau moet je je afvragen:computerwetenschappers - definiëren van eerlijkheid? Dit is een taak die normaal gesproken wordt toegewezen aan sociale wetenschappers? IBM was zich bewust van deze ongerijmdheid en maakte duidelijk dat noch Mojsilovic, noch Varshney in een vacuüm werkt. Ze brachten een groot aantal geleerden en instituten binnen. Varshney nam deel aan de Uehiro-Carnegie-Oxford Ethics Conference, gesponsord door de Carnegie Council for Ethics in International Affair. Mojsilovic nam deel aan een AI-workshop in Berkeley, Californië, gesponsord door de UC Berkeley Law School.

Is een algoritme neutraal?

Sociale wetenschappers wijzen al een tijdje op het probleem van AI-bias.

Young Mie Kim, professor, School voor Journalistiek en Massacommunicatie aan de Universiteit van Wisconsin-Madison, legt uit:"AI-discriminatie (of AI-bias) kan optreden wanneer het impliciet of expliciet bestaande ongelijke sociale ordes en vooroordelen (bijv. geslacht, ras, leeftijd, sociale/economische status, enz.).” Voorbeelden variëren van steekproeffouten (bijvoorbeeld ondervertegenwoordiging van bepaalde demografische gegevens als gevolg van ongepaste of moeilijkheden bij steekproefmethoden) tot menselijke vooroordelen bij machinetraining (modellering). Kim voerde aan dat AI-bias zelfs bestaat bij 'strategische beslissingen' in ontwerp of modellering, zoals algoritmen voor politieke advertenties.

In haar recente studie getiteld "Algorithmic Opportunity:Digital Advertising and Inequality of Political Involvement", demonstreerde Kim hoe ongelijkheid kan worden versterkt in op algoritmen gebaseerde beslissingen.

De technische gemeenschap zou kunnen beweren dat "een algoritme neutraal is" of kan worden "opgeleid" (getraind). Kim merkte op:"Dat erkent niet dat vooroordelen in elk stadium van de ontwikkeling van algoritmen optreden."

Internet of Things-technologie

- Machine learning op AWS; Weet het allemaal

- De toeleveringsketen en machine learning

- De effectiviteit van de betrouwbaarheidstraining maximaliseren

- Mobius introduceert trainingssoftware voor machinebalancering

- NXP verdubbelt machine learning at the Edge

- Machine learning gebruiken in de hedendaagse zakelijke omgeving

- Machine learning in het veld

- De PID-leercurve aanpakken

- Machine learning in voorspellend onderhoud

- Voorspel de levensduur van de batterij met machine learning

- Het leven als AI-onderzoeker en machine learning-ingenieur