Microcontroller-architecturen evolueren voor AI

Wat krijg je als je AI kruist met het IoT? De AIoT is het simpele antwoord, maar je krijgt ook een enorm nieuw toepassingsgebied voor microcontrollers, mogelijk gemaakt door de vooruitgang in neurale netwerktechnieken, wat betekent dat machine learning niet langer beperkt is tot de wereld van supercomputers. Tegenwoordig kunnen applicatieprocessors van smartphones AI-inferentie uitvoeren voor beeldverwerking, aanbevelingsengines en andere complexe functies.

Een ecosysteem van miljarden IoT-apparaten krijgt de komende jaren mogelijkheden voor machine learning (Afbeelding:NXP)

Het brengen van dit soort mogelijkheden naar de bescheiden microcontroller biedt een enorme kans. Stel je een hoortoestel voor dat AI kan gebruiken om achtergrondgeluid van gesprekken te filteren, slimme huishoudelijke apparaten die het gezicht van de gebruiker kunnen herkennen en overschakelen naar hun persoonlijke instellingen, en AI-compatibele sensornodes die jarenlang op de kleinste batterijen kunnen werken. Het verwerken van de gegevens op het eindpunt biedt latentie-, beveiligings- en privacyvoordelen die niet kunnen worden genegeerd.

Het bereiken van zinvolle machine learning met apparaten op microcontroller-niveau is echter geen gemakkelijke taak. Geheugen, een belangrijk criterium voor AI-berekeningen, is bijvoorbeeld vaak ernstig beperkt. Maar datawetenschap vordert snel om de modelgrootte te verkleinen, en apparaat- en IP-leveranciers reageren door tools te ontwikkelen en functies op te nemen die zijn afgestemd op de eisen van moderne machine learning.

TinyML gaat van start

Als teken van de snelle groei van deze sector, gaat de TinyML Summit (een nieuw branche-evenement eerder deze maand in Silicon Valley) steeds krachtiger. De eerste top, die vorig jaar werd gehouden, had 11 sponsorbedrijven, terwijl het evenement dit jaar 27 had, en de slots waren veel eerder uitverkocht, volgens de organisatoren, die ook zeiden dat het lidmaatschap voor hun wereldwijde maandelijkse bijeenkomsten voor ontwerpers dramatisch is gegroeid.

"We zien een nieuwe wereld met biljoenen intelligente apparaten die mogelijk worden gemaakt door TinyML-technologieën die detecteren, analyseren en autonoom samenwerken om een gezondere en duurzamere omgeving voor iedereen te creëren", zei Evgeni Gousev, medevoorzitter van het TinyML-comité, in zijn openingstoespraak tijdens de show.

Gousev schreef deze groei toe aan de ontwikkeling van energiezuinigere hardware en algoritmen, gecombineerd met meer volwassen softwaretools. Bedrijfs- en VC-investeringen nemen toe, evenals startup- en fusies en overnames, merkte hij op.

Tegenwoordig is het TinyML-comité van mening dat de technologie is gevalideerd en dat de eerste producten die machine learning in microcontrollers gebruiken, binnen 2-3 jaar op de markt moeten komen. Er wordt gedacht dat 'Killer-apps' 3-5 jaar verwijderd zijn.

Een groot deel van de technische validatie kwam afgelopen lente toen Google voor het eerst een versie van zijn TensorFlow-framework voor microcontrollers demonstreerde. TensorFlow Lite voor Microcontrollers is ontworpen om te draaien op apparaten met slechts kilobytes geheugen (de core-runtime past in 16 KB op een Arm Cortex M3, en met voldoende operators om een spraaksleutelwoorddetectiemodel uit te voeren, neemt het in totaal 22 KB in beslag). Het ondersteunt alleen gevolgtrekking (geen training).

Grote spelers

De grote makers van microcontrollers volgen natuurlijk met belangstelling de ontwikkelingen in de TinyML-gemeenschap. Naarmate onderzoek ervoor zorgt dat neurale netwerkmodellen kleiner worden, wordt hun kans groter.

De meeste hebben een soort van ondersteuning voor machine learning-toepassingen. STMicroelectronics heeft bijvoorbeeld een uitbreidingspakket, STM32Cube.AI, dat het mogelijk maakt om neurale netwerken in kaart te brengen en uit te voeren op zijn STM32-familie van op Arm Cortex-M gebaseerde microcontrollers.

Renesas heeft zijn e-AI-ontwikkelomgeving waarmee AI-inferentie kan worden geïmplementeerd op microcontrollers. Het vertaalt het model effectief in een vorm die bruikbaar is in zijn e 2 studio, compatibel met C/C++-projecten.

NXP zei dat het klanten heeft die zijn lagere Kinetis- en LPC-MCU's gebruiken voor machine learning-toepassingen. Het bedrijf omarmt AI met hardware- en softwareoplossingen, zij het voornamelijk gericht op zijn grotere applicatieprocessors en crossover-processors (tussen applicatieprocessors en microcontrollers).

Sterk gewapend

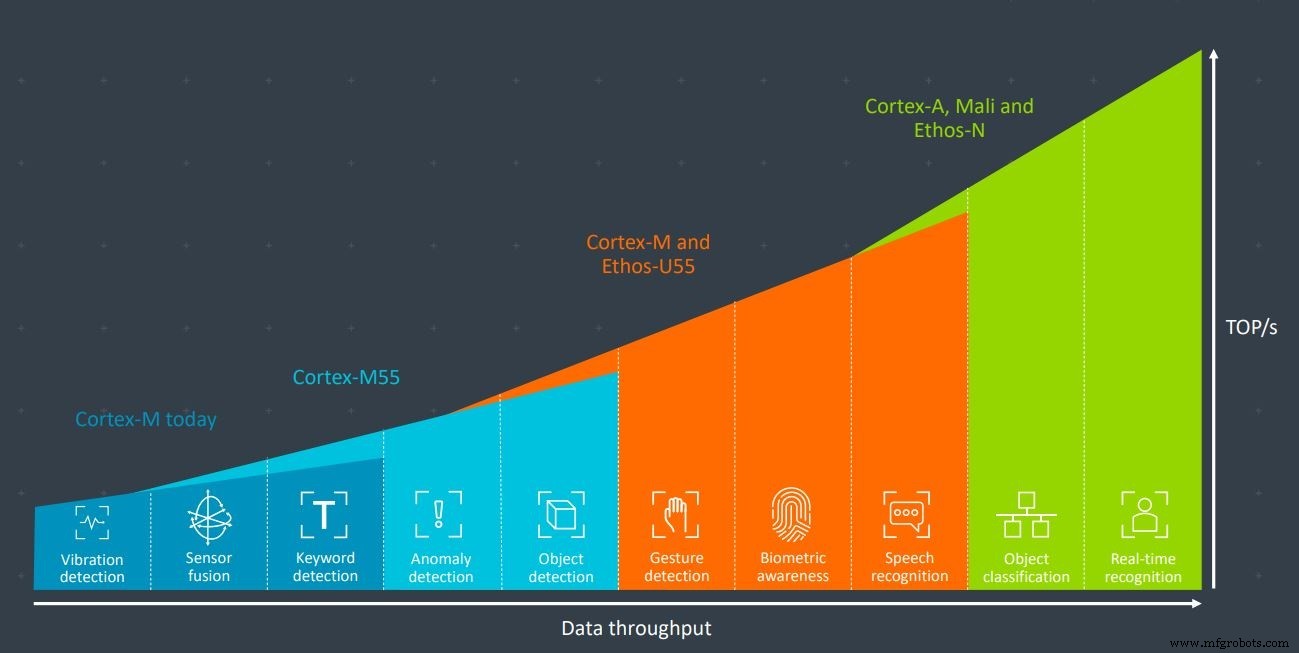

De meeste gevestigde bedrijven op het gebied van microcontrollers hebben één ding gemeen:Arm. De gigant van de embedded processorkern domineert de markt voor microcontrollers met zijn Cortex-M-serie. Het bedrijf heeft onlangs de gloednieuwe Cortex-M55-kern aangekondigd die speciaal is ontworpen voor machine learning-toepassingen, vooral wanneer deze wordt gebruikt in combinatie met de Ethos-U55 AI-versneller. Beide zijn ontworpen voor omgevingen met beperkte middelen.

Samen gebruikt, hebben de Arm's Cortex-M55 en Ethos-U55 voldoende verwerkingskracht voor toepassingen zoals gebarenherkenning, biometrie en spraakherkenning (Afbeelding:Arm)

Maar hoe kunnen startups en kleinere bedrijven proberen te concurreren met de grote spelers op deze markt?

“Niet door op Arm gebaseerde SoC's te bouwen! Omdat ze dat heel goed doen”, lachte XMOS-CEO Mark Lippett. "De enige manier om tegen die jongens te concurreren, is door een architectonisch voordeel te hebben ... [dat betekent] de intrinsieke mogelijkheden van de Xcore in termen van prestaties, maar ook de flexibiliteit."

Hoewel XMOS' Xcore.ai, de nieuw uitgebrachte crossover-processor voor spraakinterfaces, niet rechtstreeks zal concurreren met microcontrollers, blijft het sentiment waar. Elk bedrijf dat een op ARM gebaseerde SoC maakt om te concurreren met de grote jongens, kan maar beter iets heel speciaals in hun geheime saus hebben.

Scaling spanning en frequentie

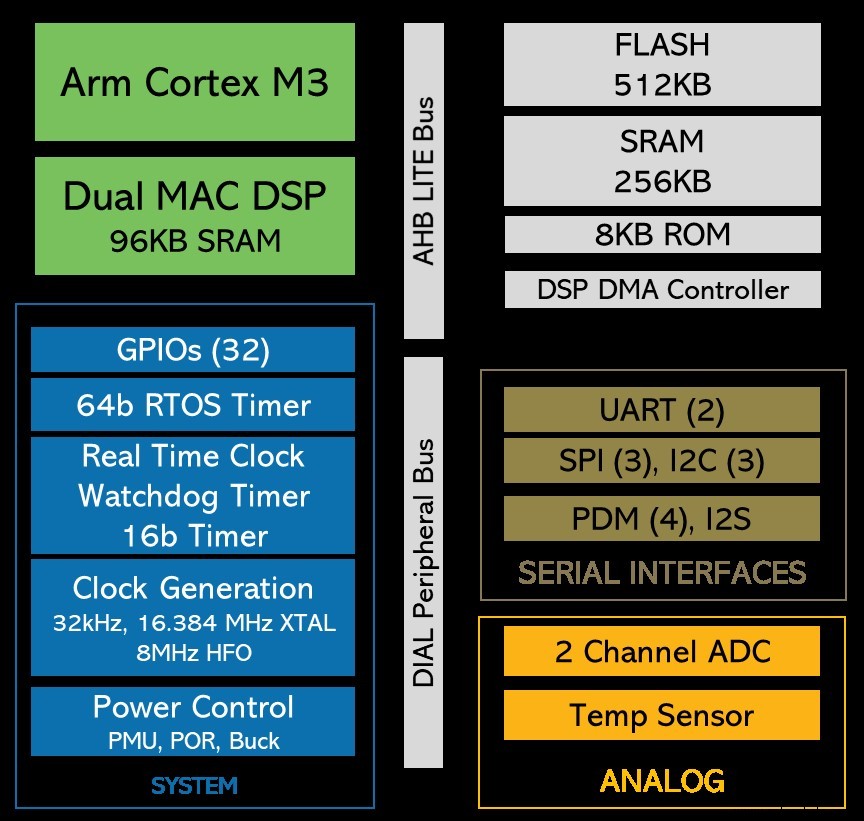

Startup Eta Compute heeft tijdens de TinyML-show zijn langverwachte ultra-low power-apparaat uitgebracht. Het kan worden gebruikt voor machine learning in always-on beeldverwerkings- en sensorfusietoepassingen met een vermogensbudget van 100 µW. De chip maakt gebruik van een Arm Cortex-M3-kern plus een NXP DSP-kern - een of beide kernen kunnen worden gebruikt voor ML-werkbelasting. De geheime saus van het bedrijf heeft verschillende ingrediënten, maar de sleutel is de manier waarop het zowel de klokfrequentie als het voltage continu schaalt, voor beide kernen. Dit bespaart veel stroom, vooral omdat het wordt bereikt zonder een PLL (phase locked loop).

De ECM3532 van Eta Compute gebruikt een Arm Cortex-M3-kern plus een NXP CoolFlux DSP-kern. De machine learning-werklast kan door een van beide of door beide worden afgehandeld (Afbeelding:Eta Compute)

Waarom heeft Eta Compute ervoor gekozen om een Arm-kern te gebruiken voor het versnellen van machine learning met ultralaag vermogen?

"Het simpele antwoord is dat het ecosysteem voor Arm gewoon zo goed ontwikkeld is", vertelde Tewksbury aan EETimes . “Het is gewoon veel gemakkelijker om naar productie te gaan [met Arm] dan met RISC-V op dit moment. Die situatie zou in de toekomst kunnen veranderen... RISC-V heeft zijn eigen voordelen; het is zeker goed voor de Chinese markt, maar we kijken nu vooral naar de binnenlandse en Europese markten met het ecosysteem voor [ons apparaat].”

Tewksbury merkte op dat de grote uitdaging voor de AIoT de breedte en diversiteit van de toepassingen is. De markt is nogal gefragmenteerd, met veel relatief niche-applicaties die slechts lage volumes afdwingen. Alles bij elkaar strekt deze sector zich echter potentieel uit tot miljarden apparaten.

"De uitdaging voor ontwikkelaars is dat ze het zich niet kunnen veroorloven om de tijd en het geld te investeren in het ontwikkelen van op maat gemaakte oplossingen voor elk van die use-cases", aldus Tewksbury. “Dat is waar flexibiliteit en gebruiksgemak absoluut voorop staan. En dat is nog een reden waarom we voor Arm hebben gekozen - omdat het ecosysteem er is, de tools er zijn en het voor klanten gemakkelijk is om producten snel te ontwikkelen en snel op de markt te brengen zonder veel maatwerk."

Na tientallen jaren zijn ISA achter slot en grendel te hebben gehouden, kondigde Arm afgelopen oktober eindelijk aan dat het klanten in staat zou stellen hun eigen aangepaste instructies te bouwen voor het afhandelen van gespecialiseerde workloads zoals machine learning. Deze mogelijkheid, in de juiste handen, kan ook de mogelijkheid bieden om het stroomverbruik verder te verminderen.

Eta Compute kan hier nog geen gebruik van maken, omdat het niet met terugwerkende kracht van toepassing is op bestaande Arm-cores, en dus niet van toepassing is op de M3-core die Eta gebruikt. Maar zou Tewksbury kunnen zien dat Eta Compute de aangepaste Arm-instructies gebruikt in toekomstige productgeneraties om het stroomverbruik verder te verminderen?

"Absoluut, ja," zei hij.

Alternatieve ISA's

RISC-V krijgt dit jaar veel aandacht. De open-source ISA maakt het ontwerp van processors mogelijk zonder licentievergoeding, terwijl ontwerpen op basis van de RISC-V ISA kunnen worden beschermd zoals bij elk ander type IP. Ontwerpers kunnen kiezen welke extensies ze willen toevoegen en kunnen hun eigen aangepaste extensies toevoegen.

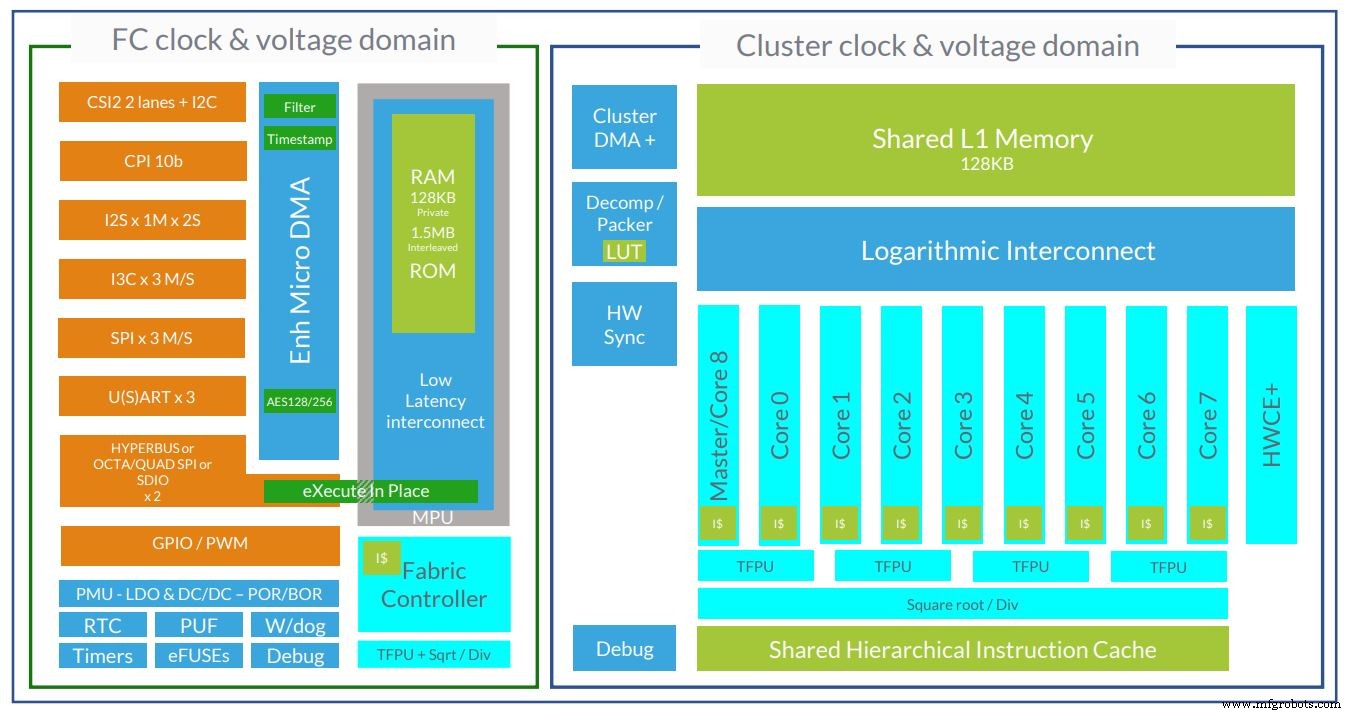

De Franse startup GreenWaves is een van de vele bedrijven die RISC-V-cores gebruiken om zich te richten op de ultra-low power machine learning-ruimte. De apparaten, GAP8 en GAP9, gebruiken respectievelijk 8- en 9-core compute-clusters.

De architectuur van de GAP9 ultra-low power AI-chip van GreenWaves gebruikt nu 10 RISC-V-cores (Afbeelding:GreenWaves)

Martin Croome, vice-president bedrijfsontwikkeling bij GreenWaves, legde uit aan EETimes waarom het bedrijf RISC-V-kernen gebruikt.

"De eerste reden is dat RISC-V ons de mogelijkheid geeft om de kernen aan te passen op het niveau van de instructieset, die we veel gebruiken", zei Croome, die uitlegt dat de aangepaste extensies worden gebruikt om de kracht van zowel machine learning als signaalverwerkingsworkloads te verminderen . “Toen het bedrijf werd opgericht, was het onmogelijk of zou het je een fortuin kosten als je dat met een andere processorarchitectuur wilde doen. En het fortuin dat het je zou gaan kosten, was in wezen het geld van je belegger dat naar een ander bedrijf ging, en dat is heel moeilijk te rechtvaardigen."

De aangepaste extensies van GreenWaves alleen al geven de kernen een 3,6x verbetering van het energieverbruik in vergelijking met ongewijzigde RISC-V-kernen. Maar Croome zei ook dat RISC-V fundamentele technische voordelen heeft, simpelweg omdat het nieuw is.

“Het is een zeer schone, moderne instructieset. Het heeft geen bagage. Dus vanuit een implementatieperspectief is de RISC-V-kern eigenlijk een eenvoudigere structuur, en eenvoudig betekent minder stroom, "zei hij.

Croome noemde ook controle als een belangrijke factor. Het GAP8-apparaat heeft 8 kernen in zijn rekencluster en GreenWaves heeft zeer fijne, gedetailleerde controle over de kernuitvoering nodig om maximale energie-efficiëntie mogelijk te maken. RISC-V maakt dat mogelijk, zei hij.

"Uiteindelijk, als we dat allemaal met Arm hadden kunnen doen, zouden we dat allemaal met Arm hebben gedaan, het zou een veel logischere keuze zijn geweest ... Omdat niemand ooit is ontslagen omdat hij Arm had gekocht", grapte hij. . "De softwaretools hebben een volwassenheidsniveau dat veel hoger is dan dat van RISC-V... maar dat gezegd hebbende, er is nu zoveel focus op RISC-V dat die tools heel snel volwassener worden."

Samenvattend, hoewel sommigen de greep van Arm op de microprocessormarkt als verzwakkend beschouwen, deels als gevolg van de toegenomen concurrentie van RISC-V, reageert het bedrijf door enkele aangepaste uitbreidingen toe te staan en nieuwe kernen te ontwikkelen die vanaf het begin zijn ontworpen voor machine learning.

Er komen zelfs zowel Arm- als niet-Arm-apparaten op de markt voor machine learning-toepassingen met ultralaag vermogen. Terwijl de TinyML-gemeenschap blijft werken aan het verkleinen van de grootte van neurale netwerkmodellen en het ontwikkelen van speciale frameworks en tools, zal deze sector uitgroeien tot een gezond toepassingsgebied dat een verscheidenheid aan verschillende apparaattypen zal ondersteunen.

Ingebed

- Snijoplossing voor de tapijtindustrie – digitale snijmachine

- Een checklist voor uitlijning en zachte voet

- Een gids voor het kopen van gebruikte CNC-machines

- 4 tips voor beginners met CNC-freesmachines

- Koopgids voor gebruikte CNC-draaibanken

- Veiligheidstips voor CNC-machines

- Koopgids voor gebruikte CNC-machines

- Tips voor het kiezen van de juiste CNC-machine

- Beste metalen CNC-machine voor metaalbedrijven in 2022

- 2090 hout CNC-machine voor een klant in Australië

- 7 Aankooptips voor ATC CNC-router